Claude İstanbul - AI Ethics by Design: Etkinlik Notları

AI Safety İstanbul Etkinlik Notları - 13 Mayıs 2026 | İstanbul, Komünite

Geçtiğimiz çarşamba akşamı AI Safety Istanbul (ASIST) olarak Komünite’nin düzenlediği “AI Ethics by Design” Claude Community etkinliğine katıldık. Etkinliği organize eden Fatih Güner kısa bir giriş yaptı ve sunumuyla salona çok değerli bir perspektif katan Nesibe Kırış Can değerli bilgiler paylaştı, bu yazıda bunları özetleyeceğiz.

ASIST olarak yapay zeka güvenliği alanında çalışan bir topluluk olduğumuz için bu etkinlik bizim açımızdan özellikle anlamlıydı. Çoğu zaman bu tür buluşmalarda “hangi model daha iyi, hangi prompt daha etkili” konuşulurken, burada çok daha derin bir katmana inildi: etik, sorumluluk, YZ’nın Türkiye’deki hukuki tanımı, kullanıcı güvenliği, yz ve hukuk ilişkisi, regülasyonlar ve gerçek hayattaki riskler.

“AI Kullanıyoruz” Demek Yetmiyor

Etkinlikte en çok üzerinde durulan konulardan biri şuydu: bir kurumda yapay zeka kullanıldığını söylemek tek başına hiçbir şey ifade etmiyor. Asıl sorulması gereken sorular var. Hangi plan kullanılıyor? Hangi yetkilendirme yapıldı? Veriler nereye gidiyor? Log altyapısı var mı?

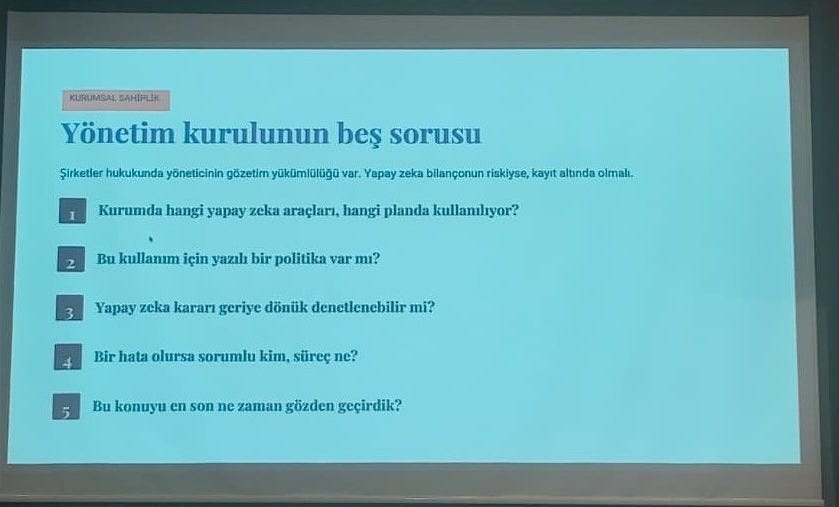

Sunumda paylaşılan “Yönetim Kurulunun Beş Sorusu” çerçevesi bu konuda çok somut bir rehber sundu:

Kurumda hangi yapay zeka araçları, hangi planda kullanılıyor?

Bu kullanım için yazılı bir politika var mı?

Yapay zeka kararı geriye dönük denetlenebilir mi?

Bir hata olursa sorumlu kim, süreç ne?

Bu konuyu en son ne zaman gözden geçirdik?

Şirketler hukukunda yöneticinin gözetim yükümlülüğü var. Yapay zeka bilançonun bir riski haline geldiyse, bunun kayıt altında olması gerekiyor. Bu beş soru, herhangi bir yönetim kurulu üyesinin bugün masaya koyması gereken sorular.

SSK Çerçevesi: Sahiplik, Sınırlar, Kanıt

Etkinlikte dikkatimi çeken bir diğer çerçeve de SSK modeliydi. Üç basit ama güçlü soru:

Sahiplik: Kim sorumlu? Sözleşmede taraf kim? Hangi tier kullanılıyor? DPA imzalı mı? Bir hata olursa kim cevap verir?

Sınırlar: Yapay zeka nereye kadar yetkili? Hangi kararlar yapay zekaya bırakılıyor, hangileri insan onayında kalıyor? Geri alınamaz aksiyonlar listesi var mı?

Kanıt: Nasıl doğrulanır? Hangi loglar tutuluyor, hangi denetim yapılıyor, hangi raporlar üretiliyor? Geriye dönük denetlenebilirlik sağlanıyor mu?

Bu üç soruyu yanıtlayamıyorsanız risk var. Yanıtlayabiliyorsanız savunulabilirsiniz. Basit ama o kadar etkili bir çerçeve ki, her ölçekteki şirkete uygulanabilir.

EU AI Act ve Risk Katmanları

Avrupa Birliği’nin yapay zeka düzenlemesi olan EU AI Act’in risk sınıflandırması da detaylı şekilde ele alındı:

Yasaklanan uygulamalar: Sosyal puanlama, bilinçaltı manipülasyon, işyerinde duygu tanıma gibi alanlar.

Yüksek riskli: İşe alım, eğitim, sağlık ve kredi değerlendirme süreçlerinde kullanılan yapay zeka sistemleri.

Sınırlı riskli: Chatbotlar, duygusal yapay zeka uygulamaları ve deepfake bildirimleri.

Düşük riskli: İçerik tavsiye sistemleri, spam filtreleri gibi uygulamalar.

Türkiye’de Durum Ne?

Etkinlikte sıkça gündeme gelen konulardan biri de Türkiye’nin henüz tanımlı bir yapay zeka yasasına sahip olmamasıydı. Yapay zeka için bir aciliyet henüz hissedilmiyor. Peki Türkiye’de yapay zeka kullanan şirketler şu anda hangi yasal çerçeveye göre hareket edecek? Bu belirsizlik hem şirketler hem bireyler için ciddi bir risk oluşturuyor.

Üretici YZ, Ajan YZ ve Sorumluluk Meselesi

Etkinlikte üzerinde durulması gereken önemli bir ayrım da üretici (generative) yapay zeka ile ajan (agentic) yapay zeka arasındaki farktı. Framework nedir, guardrail nedir, prensip nedir soruları tartışıldı. Özellikle ajan sistemlerde geri alınamaz aksiyonlar, yetki aşımı ve log eksikliği konuları somut örneklerle ele alındı.

Yapay zekanın aldığı aksiyonların sorumluluğu kimde? Bu soru, özellikle ajanların artan otonomisiyle birlikte giderek daha kritik hale geliyor. Algoritmalar hata yaptığında sorumluluk kimde - sorumluluk boşluğu kavramlarını detaylı ele aldığımız önceki yazımıza göz atabilirsiniz bu noktada :)

Who Bears the Burden When Algorithms Fail?

https://blog.safenlp.org/p/who-bears-the-burden-when-algorithms

Kurumsal vs. Tüketici: Veri Nereye Gidiyor?

“Pazarlama dili sözleşme dili değildir.” Bu cümle etkinliğin en çarpıcı tespitlerinden biriydi. “Veri eğitime gitmez” gibi ifadelerin hangi planda, hangi kapsamda geçerli olduğunu sorgulamak gerekiyor. Enterprise tier ile consumer tier arasındaki veri koruma farkları, sözleşme şartları ve politika dokümanlarını okumanın önemi vurgulandı.

Dil modellerinin “abartılı kelime üreticisi” olması ve bunun oluşturduğu duygusal, toplumsal yük de insani bir perspektiften ele alındı.

Danışmanlık Mesleğinin Geleceği

Etkinlikte kısaca değinilen ama beni düşündüren bir konu da formülüze edilebilir alanlardaki danışmanlık hizmetlerinin geleceğiydi. Sözleşme hazırlama gibi yapılandırılmış işleri yapan danışmanlıklar için yapay zeka ciddi bir dönüşüm getiriyor. Bu alanda mesleğin nasıl evrileceği ayrı bir tartışma konusu. Anthropic’in daha yeni sunduğu ‘Claude for Legal’ aracının bu noktada danışmanlık sektörünün şekillenmesinde etkili olacağı vurgulandu.

Son Söz

Bu etkinlikten aldığım en büyük mesaj şu oldu: yapay zeka artık sadece bir teknoloji tartışması değil. İzinler, süreçler, denetim ve sorumluluk boyutları giderek daha kritik hale geliyor. “Ne yapabildiği” kadar “nasıl ve hangi sınırlar içinde yaptığı” da önemli.

Mesai çıkışı, İstanbul trafiğinin ortasından gelip saatlerce bu konuları tartışan herkese, organizasyonu bir araya getiren Fatih Güner’e ve bilgi birikimini cömertçe paylaşan Nesibe Kırış Can’a teşekkürler.

ASIST olarak bu tür etkinliklere katılmaya ve yapay zeka güvenliği konusundaki diyaloğa katkı sunmaya devam edeceğiz. Böyle topluluklar ve bu tür buluşmalar, yapay zekanın geleceğini şekillendirmede gerçekten fark yaratıyor. Etkinliklerimizden haberdar olmak için bizi takip edebilirsiniz, https://linkedin.com/company/ai-safety-istanbul

ASIST is the front layer of safenlp.org, powered and shielded by its infrastructure to reach and engage with the broader AI safety community. While safenlp.org drives the core research and safety tooling, ASIST serves as the national and international engagement and collaboration layer, connecting people and organizations who care about responsible AI. Sign up for our newsletter to stay informed about upcoming events, new collaborations, and ways to get involved.

hello@aisafetyistanbul.org & merhaba@aisafetyistanbul.org

Shielded by safenlp.org